robots文件对网站SEO优化有什么帮忙

无论有哪些站点,我们都会发明都存在robots这个文件,这关于优化可否有帮忙我们不得而知,但是无论是大型网站还是小型网站,都会让运用一些下令封锁蜘蛛不让抓取某个栏目,这对网站优化的帮忙表现在哪些方面呢?下面我们就来理解下。

确保您没有屏蔽要抓取的网站的任何内容或局部。

将不会遵循robots.txt阻止的网页上的链接。这意味着1.)除非它们也与其他搜寻引擎可拜访的页面链接(即未通过robots.txt,元机器人或其他方式阻止的页面),否则链接的资源将不会被抓取,也不会被编入索引。2.)没有链接资产可以从被阻止的页面通报到链接目的地。要是您有要将权利通报到的页面,请运用robots.txt之外的其他阻止机制。

不要运用robots.txt来防止敏感数据(如私人会员信息)涌现在SERP效果中。因为其他页面可能直接链接到包括私人信息的页面(从而绕过根域或主页上的robots.txt指令),因而它仍可能被编入索引。要是要阻止搜寻效果中的页面,请运用其他办法,如密码维护或noindex 元指令。

一些搜寻引擎有多个会员代理。例如,baidu运用关键词进行天然搜寻,运用关键词进行图片搜寻。来自统一搜寻引擎的大多数会员代理遵循雷同的法则,因而无需为每个搜寻引擎的多个抓取工具指定指令,但有能力这样做可以让您微调网站内容的抓取方式。

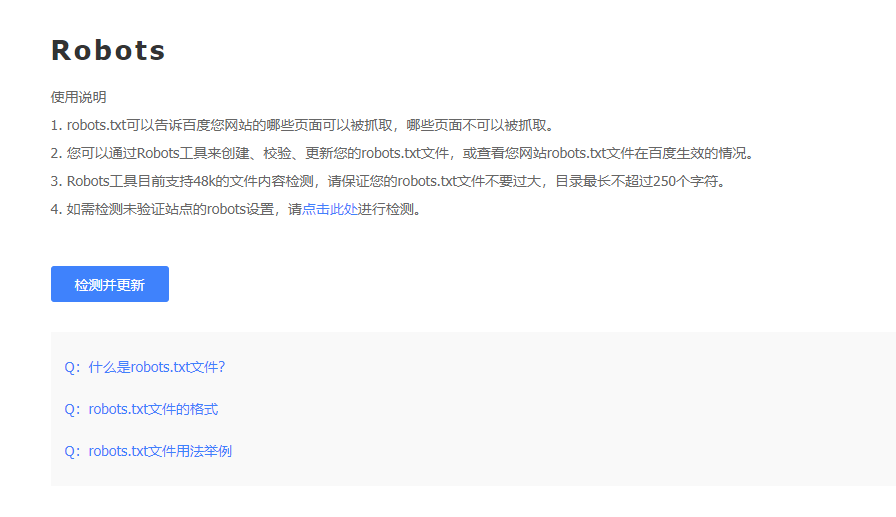

搜寻引擎将缓存robots.txt内容,但平常天天至少更新一次缓存内容。要是您更改文件并但愿更快地更新文件,则可以将您的robots.txt网址提交给baidu资源平台。